今までNVIDIAだけのように言われてきましたが、ついにこの日が来ました。

自分のPCのスペックでもローカルAIが使えるようになったのです。

この記事がきっかけ↓

実際にアプリをダウンロードするのはこちら↓

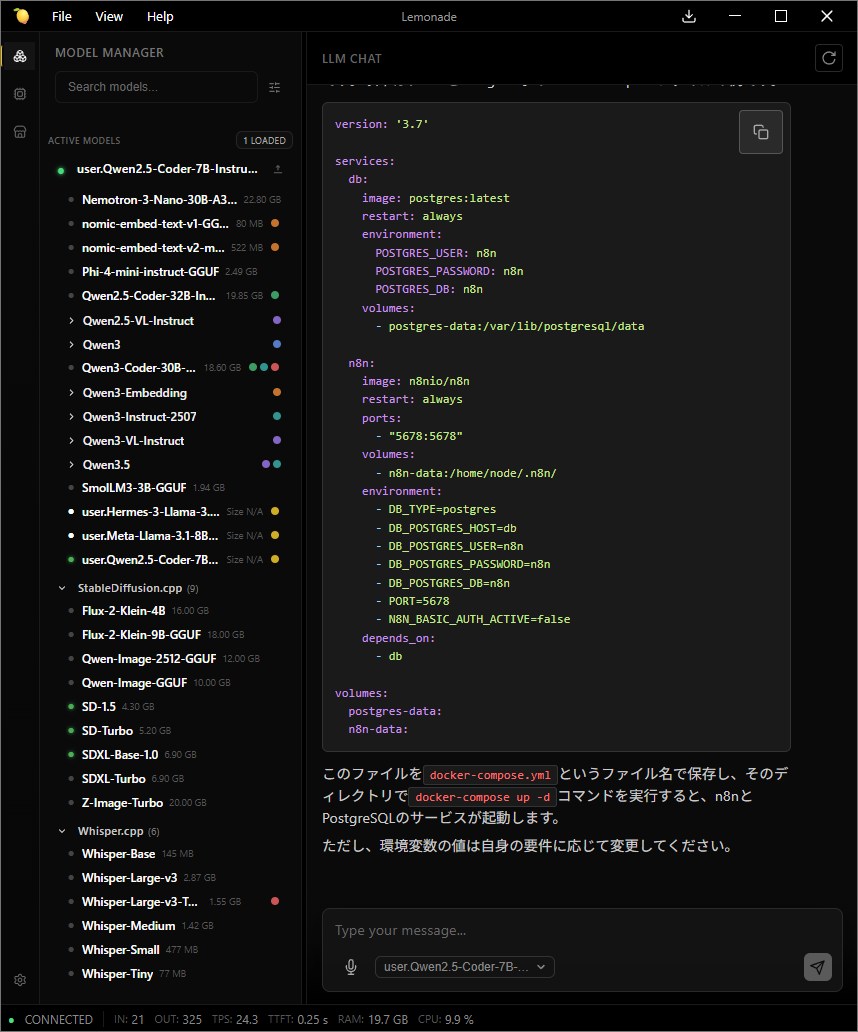

試してみた画面はこちら↓

自分のパソコンはさして特徴もないPCです。

PCのスペックは以下です

「AMD Ryzen 7 3700X 8-Core Processor 3.59 GHz」

「ASRock AMD Ryzen AM4 対応 B450 チップセット搭載 MicroATX マザーボード B450M Steel Legend」

とまぁ、ちょっと前の仕様で、それほどハイスペックでもないPCです。

それでも、動く時代が来たのかぁ。。

ちょっと、感動しました。

SynologyのコンテナマネージャーにLlamaを入れて見たりしましたが、やっぱもっさりしてたし、そもそもCPUだけで動く奴じゃダメですね。

今回のこのlemonadeは、チャット、画像生成、コード生成、音声と一通り使うことが出来るようです。

現時点だと、自分はチャットのやつ↓

Hermes-3-Llama-3.1-8B-GGUF

Meta-Llama-3.1-8B-Instruct-GGUF

を試してみました。

Hermesはホント、自然な感じの日本語でしたね。

Metaはそれよりはちょっと落ちる感じ。

でも、反応は速いし、しっかりとした回答をしてくれるので、今後が楽しみです。

コード生成用に、

Qwen2.5-Coder-7B-Instruct-GGUFを使って見ました。

n8nのDocker Composeを生成させてみたけど、これはパクって来ただけかな?

と思い、n8nのサイトに行ったら、ちゃんと生成したものみたいでした。

へ~、しっかりしてるかも。

色々と楽しくなりますね。

Radeonでも、動くのかぁ。。良かったNVIDIA買わなくて。

一応、タスクマネージャーで確認して、会話して見ると、グラボがブンブン回るのが分かります。

なので、しっかりと、使われているのが分かりました。

動画もその辺が分かるように並べてますので、参考に。